Obsah

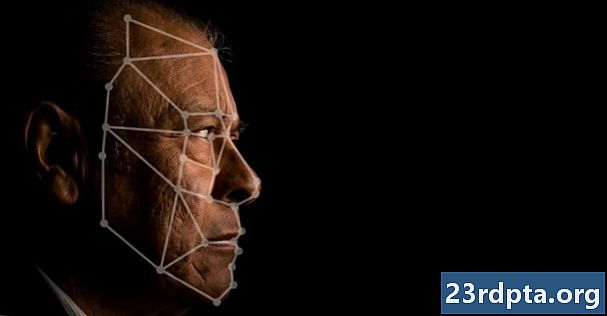

Deepfake obsah buduje chaos mezi lidmi, kteří vyrůstali s myšlenkou, že vidění věří. Fotografie a videa, kdysi považované za nepopiratelné důkazy o něčem, co se děje, jsou nyní masy zpochybňovány. To lze očekávat po zjištění úžasně realistického videa Baracka Obamy, který nazval prezidenta Trumpa „úplným a úplným poklesem ****“, není ničím jiným, než jen hluboce vytvořeným stvořením.

Deepfake obsah buduje chaos mezi lidmi, kteří vyrůstali s myšlenkou, že vidění věří.

Edgar CervantesZapojená technologie vyvolává obočí a vytváří otázky, proto jsme tu proto, abychom vám poskytli plné hluboké falešné shrnutí toho, co to je, jak to funguje, a pokud existuje opravdu důvod k obavám.

Co je hluchý?

Deepfake je technika umělé inteligence (umělá inteligence), která používá strojové učení k vytváření nebo manipulaci s obsahem. Často se používá k vytváření sestřihů nebo k překrývání tváře osoby nad druhou, ale její schopnosti přesahují mnohem dále. Tato technologie má spoustu dalších aplikací. Patří mezi ně manipulace nebo vytváření zvuku, pohybu, krajiny, zvířat a dalších.

Jak funguje deepfake?

Deepfake obsah je vytvářen technikou strojového učení známou jako GAN (generative adversarial network). GAN používají dvě neuronové sítě: generátor a diskriminátor. Ty neustále soupeří proti sobě.

Generátor se pokusí vytvořit realistický obraz, zatímco diskriminátor se pokusí určit, zda je falešný nebo ne. Pokud generátor oklamá diskriminátora, použije diskriminační informace shromážděné, aby se stal lepším soudcem. Podobně, pokud diskriminátor určí, že obraz generátoru je falešný, bude generátor lepší při vytváření falešného obrazu. Nekonečný cyklus může pokračovat, dokud obraz, video nebo zvuk již není znatelně falešný pro lidskou perspektivu.

Původy

První deepfake videa byla samozřejmě porno!

Edgar CervantesPrvní deepfake videa byla samozřejmě porno! Přesněji to bylo běžné vidět tváře celebrit překrývajících porno herečky. Nicholas Cage memy byly také populární, mezi jiné zábavné vynálezy.

Slovo deepfake se stalo synonymem této techniky v roce 2017, a to díky uživateli Reddit, který se jmenoval „deepfakes“. K uživateli se nyní přidali další uživatelé, kteří jsou nyní zakázáni r / deepfakes subreddit, kde sdíleli svá stvoření se světem.

Skutečným tvůrcem generativních kontradiktorních sítí je Ian Goodfellow. Spolu se svými kolegy představil tento koncept na univerzitě v Montrealu v roce 2014. Poté pokračoval v práci pro Google a v současné době je zaměstnán společností Apple.

Nebezpečí

Ve špatných rukou lze hluboce vytvořenou tvorbu použít k falšování mnohem více než hloupých memoí Nicholas Cage.

Edgar CervantesI když manipulace s obsahem není nic nového, vyžadovala to seriózní dovednosti. K vytvoření falešného obsahu potřebujete výkonný počítač a opravdu dobrý důvod (nebo příliš mnoho volného času). Software pro vytváření hlubokých tvorů, jako je FakeApp, je zdarma, snadno k nalezení a nevyžaduje mnoho počítačového výkonu. A protože vykonává veškerou svou práci samostatně, nemusíte být zručným editorem, abyste vytvořili šíleně skutečná hluboká média.

To je důvod, proč se veřejnost, celebrity, politické subjekty a vlády obávají hnutí hluboce falešných. Ve špatných rukou lze hluboce vytvořenou tvorbu použít k falšování mnohem více než hloupých memoí Nicholas Cage. Představte si, že někdo vytváří falešné zprávy nebo inkriminuje video důkaz. Můžete přidat falešné a pomstít porno k problému. Věci se mohou rychle zmatit.

Dalším důvodem k obavám z hlubokého falešného obsahu je skutečnost, že důležité osobnosti mohou také popírat minulé akce. Protože se videa deepfake zdají být tak skutečná, kdokoli by mohl tvrdit, že skutečný klip je falešný.

Přečtěte si také: Složitost etiky a umělé inteligence

Hledání řešení

I když je velmi blízko skutečnému, trénované oko může i nadále pozorovat falešné video pozorně. Jde o to, že v budoucnu možná nebudeme schopni rozeznat rozdíl.

Twitter, Pornhub, Reddit a další se neúspěšně pokusili zbavit takového obsahu. Na oficiálnější straně spolupracuje DARPA (agentura pro obranné pokročilé výzkumné projekty) s výzkumnými institucemi a univerzitou v Coloradu, aby vytvořily způsob, jak spatřit hluboké potoky.

To nejlepší, co můžeme v boji proti hluboce falešným videům udělat, je být více pozorný a méně naivní.

Edgar CervantesDokud nebudeme mít software, který v takových videích zjistí nesrovnalosti, to nejlepší, co můžeme udělat, je pozornější a méně naivní. Proveďte výzkum, než se domníváte, že video, obrázek nebo zvuk jsou skutečné. To je něco, co jsme už měli dělat.

Populární deepfake obsah

Jordan Peele se připojil k Buzzfeedu a sestavil toto video, které má vytvořit vědomí.

Odborník na online manipulaci Claire Wardle nám ukazuje, jak realistická může tato videa vypadat, když se během prvních 30 sekund videa zobrazí jako Adele. Toto video z The New York Times nám dává skvělý náhled na toto téma.

Watchmojo dává má kurátor seznam některých z nejpopulárnějších deepfake videa kolem. Je to zábavné video se spoustou skvělých příkladů.

Bojíte se důsledků hluchých videí? Je to určitě téma, které bychom měli mít na paměti, a zároveň pracovat na hledání řešení.